Google Rilis VaultGemma, Model AI Besar yang Fokus Pada Privasi

Google memperkenalkan VaultGemma, model bahasa baru yang fokus pada privasi. Bedanya dengan model AI biasa, VaultGemma dilatih agar tidak menyimpan atau mengulang data sensitif yang dipakai selama proses pelatihan.

Terkesan spele, tapi sebenarnya ini jadi masalah yang cukup serius. Banyak model AI besar bisa tanpa sengaja “mengingat” data pribadi, lalu memborokan informasi data pribadi tersebut kembali saat ditanya.

Baca Juga:Rekomendasi Laptop Gaming Rp 10-15 Juta 2025 (September) • Jagat Review

Nah, untuk mencegah hal itu, Google memakai teknik differential privacy. Intinya, model ini dilatih dengan tambahan “noise” sehingga tidak ada satu data pun yang bisa terlacak secara spesifik.

VaultGemma sendiri punya 1 miliar parameter dan dilatih dari nol menggunakan dataset raksasa berisi 13 triliun token teks, kode, dan artikel ilmiah. Proses pelatihannya ditenagai lebih dari dua ribu chip TPU generasi terbaru. Google bahkan membuat panduan baru untuk memahami hubungan antara privasi, performa, dan kebutuhan komputasi.

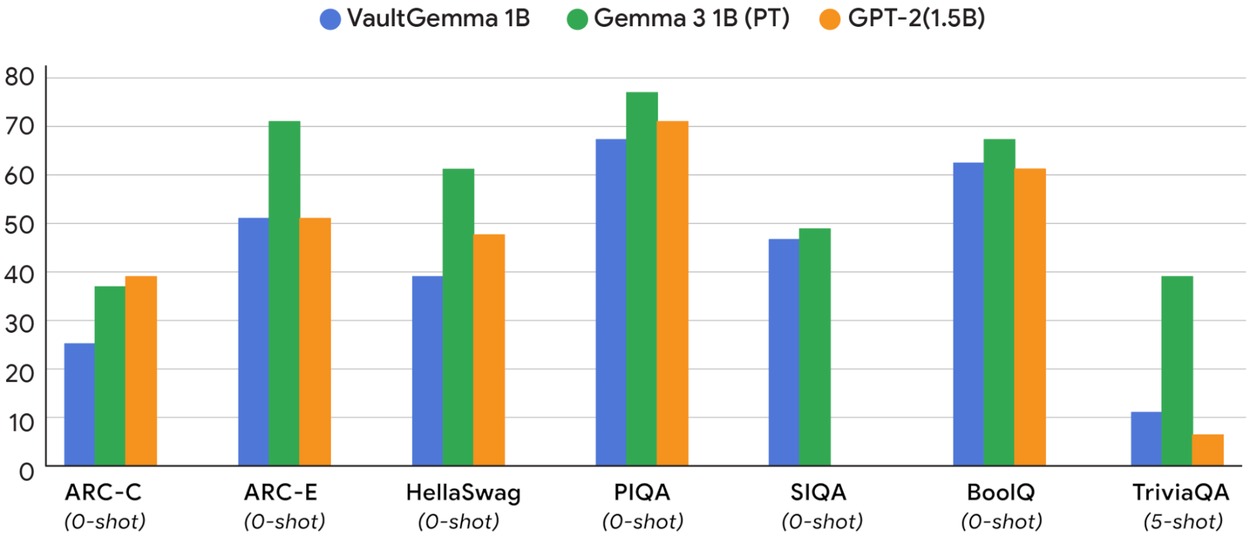

VaultGemma Tak Secerdas Gemma 3

Kalau bicara kinerja, VaultGemma memang belum bisa menyaingi model AI non-private terbaru seperti Gemma 3. Hasil uji coba menunjukkan performanya mirip model AI lima tahun lalu. Tapi yang penting, model ini benar-benar tidak menunjukkan tanda menyimpan data latihannya. Tentunya ini masih jarang dicapai di skala sebesar ini.

Google sudah merilis VaultGemma secara terbuka di Hugging Face dan Kaggle. Artinya, peneliti dan komunitas bisa langsung mencobanya, membaca laporan teknisnya, dan mengembangkan riset lanjutan.

Dengan model AI terbaru ini, Google mencoba memberi opsi baru untuk AI, yang tidak hanya cerdas, tapi juga aman untuk data pengguna. Namun, apakah kalian lebih memilih model yang super canggih tapi berisiko, atau model yang sedikit lebih terbatas tapi menjaga privasi dengan ketat?