Meta Kembangkan Empat Chip MTIA Untuk Infrastruktur Data Center

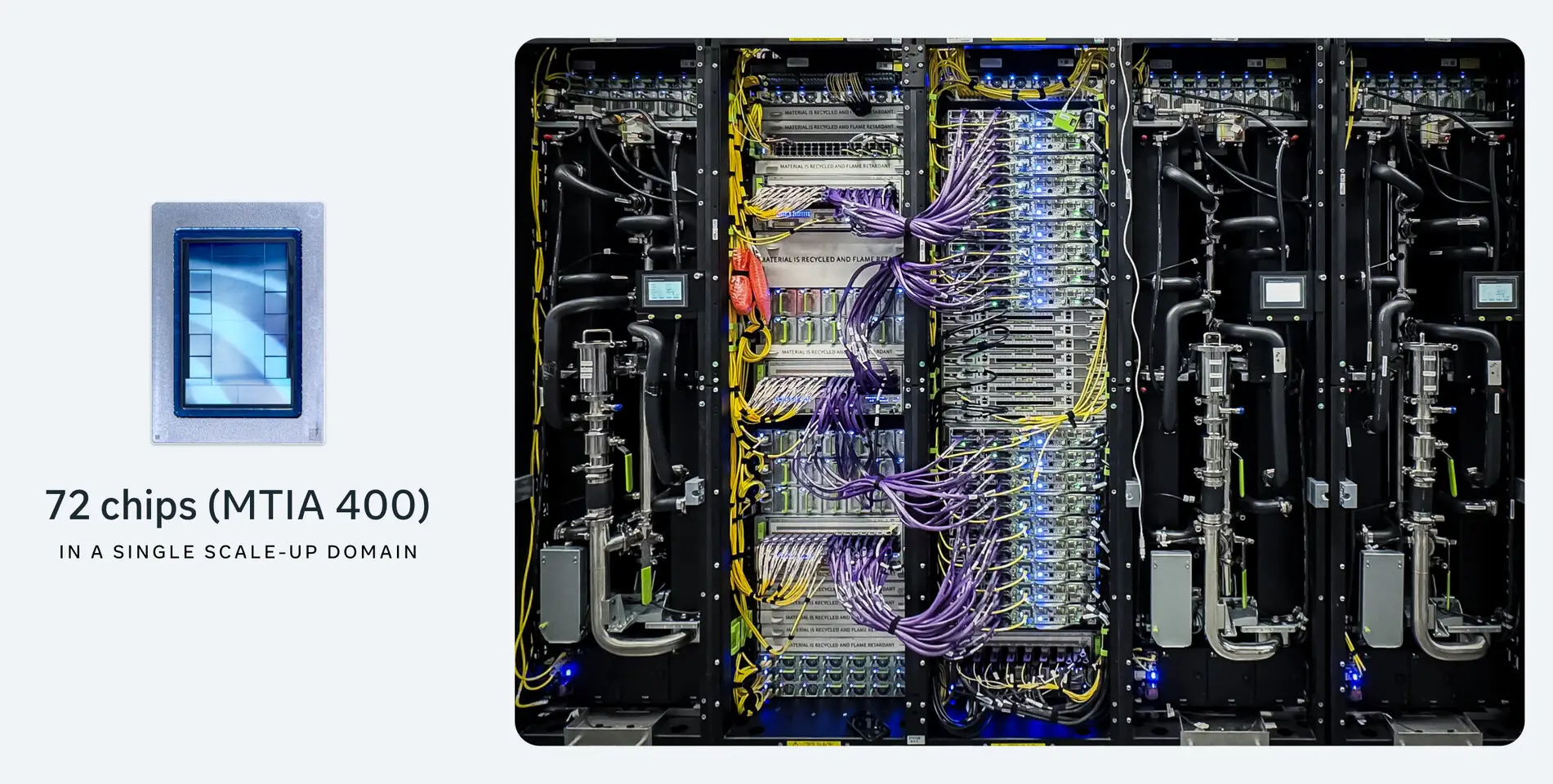

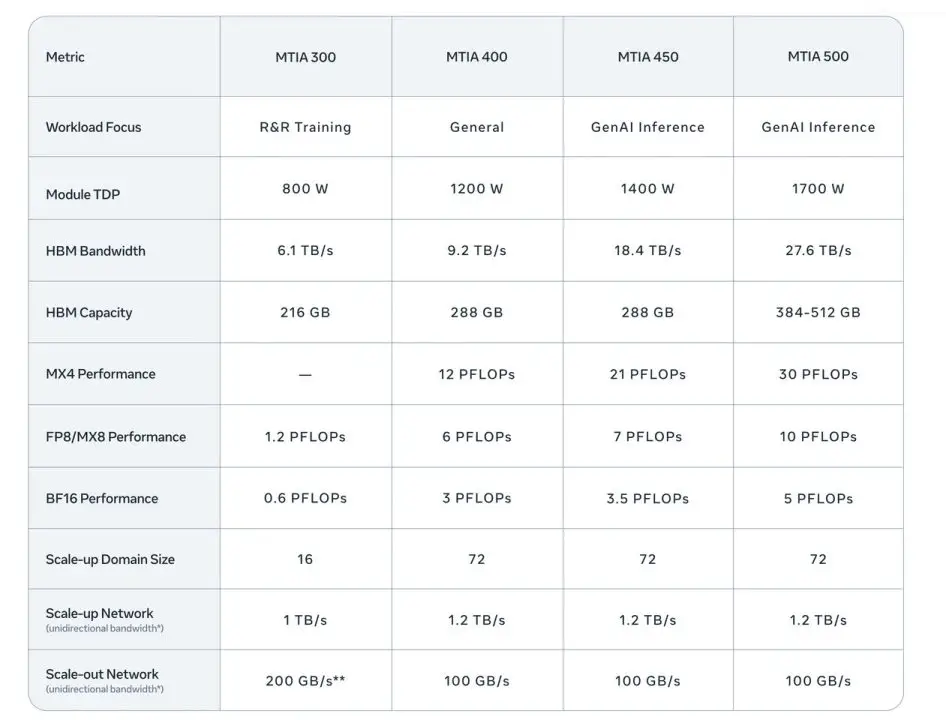

Perusahaan teknologi Meta Platforms mengumumkan peta jalan pengembangan akselerator AI internal mereka. Perusahaan mengumumkan empat chip baru dalam lini Meta Training and Inference Accelerator (MTIA) yang terdiri dari MTIA 300, MTIA 400, MTIA 450, dan MTIA 500. Perusahaan merancang chip-chip tersebut untuk mendukung kebutuhan komputasi AI di pusat data mereka, khususnya untuk menjalankan berbagai layanan platform media sosial.

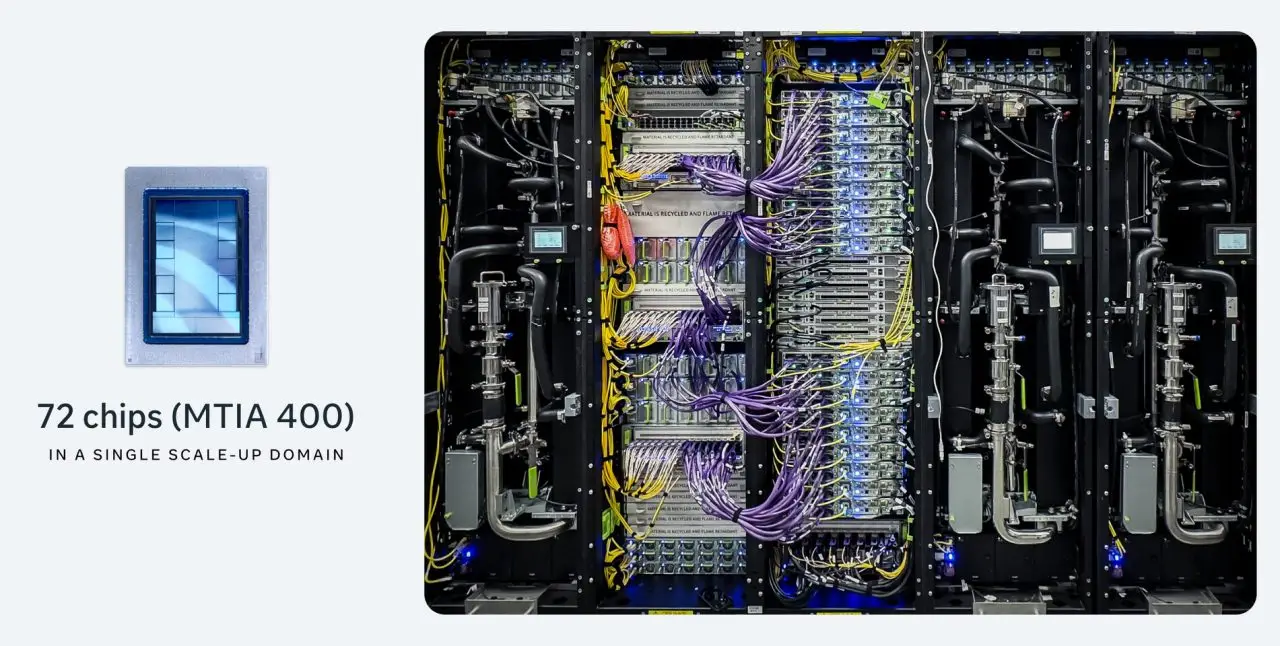

Meta mengembangkan lini MTIA tersebut bersama Broadcom dan berencana mengintegrasikannya ke pusat data perusahaan dalam dua tahun ke depan. Generasi awal chip tersebut sudah digunakan untuk menjalankan beban kerja seperti pemeringkatan dan rekomendasi konten. Sementara itu, desain generasi berikutnya dioptimalkan untuk penyajian model AI secara real-time.

Performa Chip AI Buatan Meta

Menurut tabel spesifikasi yang dibagikan perusahaan, bandwidth memori dan kapasitas HBM meningkat cukup signifikan di seluruh seri MTIA, sementara peningkatan performa komputasi berlangsung lebih bertahap. Pendekatan ini menunjukkan bahwa mereka lebih memprioritaskan bandwidth dan kapasitas memori guna mengurangi latensi serta menekan konsumsi daya dalam proses inference skala besar di pusat data.

Meta juga menyebut bahwa kompatibilitas perangkat lunak menjadi salah satu prioritas utama dalam pengembangan MTIA. Perusahaan merancang sistem ini agar dapat berjalan secara native pada berbagai kerangka kerja AI yang umum digunakan. Pendekatan tersebut memungkinkan model produksi yang sebelumnya berjalan di GPU dapat dijalankan di MTIA tanpa perlu penulisan ulang kode secara besar-besaran.

Baca Juga: ZTE dan XLSMART Rampungkan 20.000 Site MOCN di Indonesia dalam 8 Bulan

Melalui pengembangan chip MTIA ini, perusahaan berupaya membangun ekosistem hardware AI yang lebih mandiri. Perusahaan berharap strategi tersebut dapat mengurangi ketergantungan GPU dari vendor eksternal seperti NVIDIA sekaligus memberikan kontrol lebih besar terhadap performa dan efisiensi infrastruktur AI mereka di masa depan.